Inteligência artificial usa avatar e voz fake para evitar preconceito em entrevista de emprego

Hospital Sírio-Libanês, em São Paulo, utiliza sistema que não deixa o selecionador saber se a pessoa candidata à vaga é homem, mulher, branca ou negra

As empresas estão usando cada vez mais a inteligência artificial, a exemplo da ATS (sistema de rastreamento de candidato), para selecionar currículos e contratar profissionais. É um jeito de acelerar o processo, mas os robôs, que são programados por humanos, podem falhar e reproduzir preconceitos de raça, gênero e outros.

Para evitar isso, alguns sistemas já permitem que todo o processo seja anônimo. São usados avatares que mudam a imagem e a voz do candidato numa entrevista virtual. Com esse aprimoramento da IA, nem o robô nem o selecionador humano conseguem saber se é uma pessoa negra ou branca, mulher ou homem e qual o sotaque dela, por exemplo. O hospital Sírio-Libanês, em São Paulo, já está usando o sistema em alguns departamentos.

"O viés inconsciente é um gatilho cerebral que leva as pessoas a cometerem atos preconceituosos. Quando falamos que a tecnologia pode ser preconceituosa é porque temos seres humanos abastecendo essas máquinas", diz Cammila Yochabell, CEO e fundadora da Jobecam, plataforma de recursos humanos que oferece ferramentas com vídeos e currículos anônimos para empresas como o Sírio.

Algoritmo da Amazon preferia homens

Em 2018, a Amazon enfrentou um problema de preconceito automatizado. O algoritmo desenvolvido para selecionar candidatos não era neutro e priorizava homens. O algoritmo avaliava com notas baixas currículos que tinham a palavra "mulher".

Após repercussão internacional, a companhia admitiu que o sistema incitava discriminação de gênero.

Hoje ainda existem sistemas que buscam profissionais semelhantes aos que já existem em uma empresa específica, prejudicando a diversidade.

"Esse é o viés inconsciente de afinidade. É um dos motivos para haver tantos homens héteros, cis e brancos em cargos de liderança", afirma Yochabell.

Como a inteligência artificial evita preconceito

A inteligência artificial que combate o preconceito foca nas habilidades e competências do candidato, deixando de lado análise de aspectos como gênero, raça e etnia.

A seleção virtual se diferencia de outros sistemas de IA a partir de três modalidades:

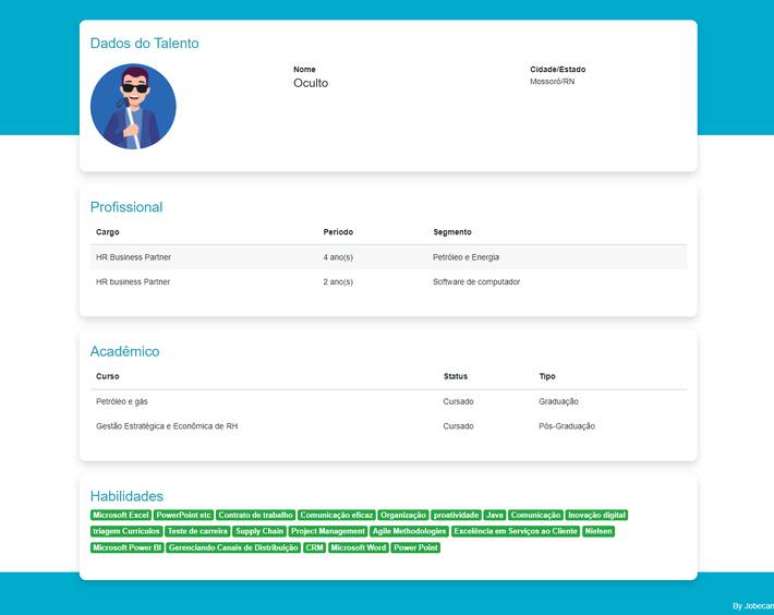

- Currículo anônimo: As informações pessoais dos candidatos são ocultadas. A análise é focada nas habilidades e experiências.

- Entrevista pré-gravada anônima: Não há interação entre recrutador e o profissional. A pessoa é revelada somente após aprovação para uma etapa seguinte.

- Entrevista ao vivo anônima: Os selecionadores têm interação em tempo real com os candidatos. Usada para dinâmica em grupo ou com gestores.

Um detalhe importante é que em todas as modalidades o rosto vira um avatar, o nome da pessoa é adaptado para o nome de uma cidade ou um país, e a voz é robotizada (com até 4 opções de modulação).

"Descaracterizamos as pessoas candidatas para enaltecer as competências delas", afirma a fundadora da Jobecam.

Durante o processo da entrevista ao vivo, a empresa escolhe se revela o rosto do candidato após 10 minutos de conversa ou se mantém o anonimato.

Sírio troca modelo para ter mais diversidade

O Hospital Sírio-Libanês é uma das empresas que adotam o modelo em alguns departamentos da companhia.

"Essa mudança veio com a nossa pauta de oferecer um ambiente mais diverso, para o setor hospitalar, onde há uma série de critérios. Estamos focados em trazer o profissional certo para a posição certa, independentemente do sexo, da cor, da orientação sexual e da crença religiosa", diz Pida Lamin, diretora de Pessoas e Cultura do Sírio-Libanês.

De agosto de 2022 a março deste ano, mais de 90 profissionais participaram desse tipo de seleção. Foram contratados 21, na seguinte proporção: 90% são mulheres, 51% representam negros, 30% LGBTQIA+ e 10% são profissionais com mais de 50 anos.

O hospital diz não ter dados das porcentagens de contratação antes desse sistema, porque não utilizava autodeclaração de gênero e raça entre os candidatos.

O recrutamento nesse formato está incorporado em cinco diretorias da instituição (Compromisso Social, Marketing, Tecnologia e Inovação, Gestão de Pessoas e Saúde Populacional).

Antes, o Sírio usava o modelo tradicional: envio de currículo, o recrutador ligava para o profissional, e depois havia entrevistas. O gestor sempre sabia se o candidato era homem ou mulher e se tinha filhos.

"Era o modelo de começar pelas questões pessoais. Agora, modificamos o processo para focar nas habilidades técnicas para desempenhar bem a função", declara Pida.

Outra mudança é a triagem. Nessa fase, o gestor tem acesso somente às experiências prévias e o quanto elas atendem a vaga. Informações pessoais, como nome, gênero, localidade e fotografia, são ocultadas.

O que vale para os filtros gerados na IA são as habilidades técnicas e comunicacionais, como assertividade, proatividade e comunicação eficaz. O profissional só é eliminado nessa etapa caso não tenha nenhuma característica para o perfil técnico do cargo oferecido.

Preconceito nasce nas empresas, não na IA

Outra empresa que usa a IA para ampliar seleções com pessoas candidatas diversas é a Portão 3, plataforma de gerenciamento de despesas corporativas, o setor de RH utiliza o LinkedIn como porta de captação. "Nós direcionamos os filtros para que não exista uma triagem específica, por exemplo, para gênero, cor e raça", diz Marcello Amaro, CHRO (diretor de RH) da Portão 3.

Porém, ele acrescenta que essas escolhas partem do recrutador, já que os campos escolhidos nesta etapa podem gerar viés inconsciente da IA durante a seleção.

"É muito mais o RH quebrando vieses, ensinando a inteligência artificial a trabalhar, do que a própria IA sendo o monstro do negócio", defende Amaro.

Em uma seleção hipotética, sem o sistema automatizado, Amaro gastaria cinco minutos por currículo. Com a IA, o CHRO já recebe os candidatos com perfil de experiência conforme o que a vaga exige.

Especialistas dizem que a responsabilidade não é exatamente da inteligência artificial, mas de quem a programa. Uma das soluções é identificar preconceitos das pessoas.

"Nosso papel é mitigar vieses inconscientes que alimentam as máquinas, principalmente, nas seleções de talentos", diz Camila Yochabell.

Ela afirma que é necessário equilibrar a eficiência da IA e o que pode se tornar preconceito no recrutamento.